在当今数据爆炸与算力需求激增的时代,网络I/O(输入/输出)性能已成为制约服务器整体效率与数据中心服务能力的关键瓶颈。传统网络架构在处理大规模、高并发、低延迟的数据交换时往往力不从心。浪潮信息,作为全球领先的算力基础设施提供商,深刻洞察这一挑战,推出了一系列创新性的服务器网络I/O加速技术,旨在彻底释放计算潜能,为各类网络密集型应用提供坚实的技术底座。

一、技术核心:软硬件协同的深度优化

浪潮服务器网络I/O加速技术并非单一功能的改进,而是一套涵盖硬件、驱动、协议栈乃至应用层的全栈式解决方案。其核心在于通过软硬件协同设计,将网络处理任务从通用CPU卸载到专用的加速引擎上,从而大幅降低CPU开销,提升数据处理效率与系统响应速度。

1. 智能网卡(SmartNIC/DPU)的深度集成:

浪潮服务器广泛集成或支持高性能智能网卡,如基于FPGA或ASIC的加速卡。这些网卡内置专用处理器,能够高效处理网络协议(如TCP/IP)、虚拟化(OVS卸载)、安全(加解密、防火墙)及存储(RDMA,远程直接内存访问)等功能。例如,通过将虚拟交换机功能卸载至智能网卡,可显著降低主机CPU的负载,使更多的计算资源服务于核心业务应用。

2. RDMA技术的全面应用:

远程直接内存访问(RDMA)是浪潮网络加速技术中的明星。它允许网络中的计算机直接从另一台计算机的内存中读取或写入数据,无需操作系统内核的介入,实现了超低延迟(微秒级)和高带宽的数据传输。浪潮服务器通过支持RoCE(RDMA over Converged Ethernet)等技术,在标准以太网上实现了RDMA,使得高性能计算(HPC)、人工智能训练、分布式存储(如Ceph)和数据库集群等应用能够实现近乎线性的性能扩展。

3. 协议栈优化与内核旁路:

在软件层面,浪潮对网络协议栈进行了深度优化。通过采用用户态网络驱动(如DPDK, Data Plane Development Kit)或特定加速库,实现了数据路径的“内核旁路”。这意味着网络数据包可以直接在用户空间和网卡之间传递,避免了内核上下文切换带来的延迟与CPU消耗,特别适合需要极高包处理速率的场景(如NFV、金融交易)。

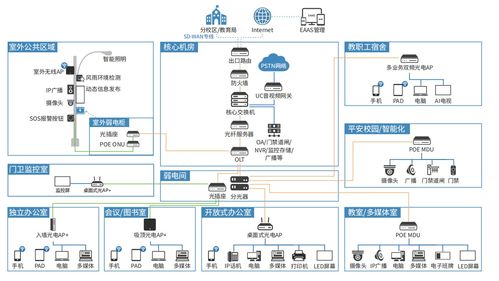

二、应用场景:赋能千行百业的网络服务

浪潮服务器网络I/O加速技术已广泛应用于对网络性能有极致要求的领域:

- 云计算与虚拟化: 在大型云数据中心,该技术通过SR-IOV(单根I/O虚拟化)和网卡虚拟化卸载,为虚拟机提供接近物理机性能的网络隔离与带宽保障,提升云主机的密度与稳定性。

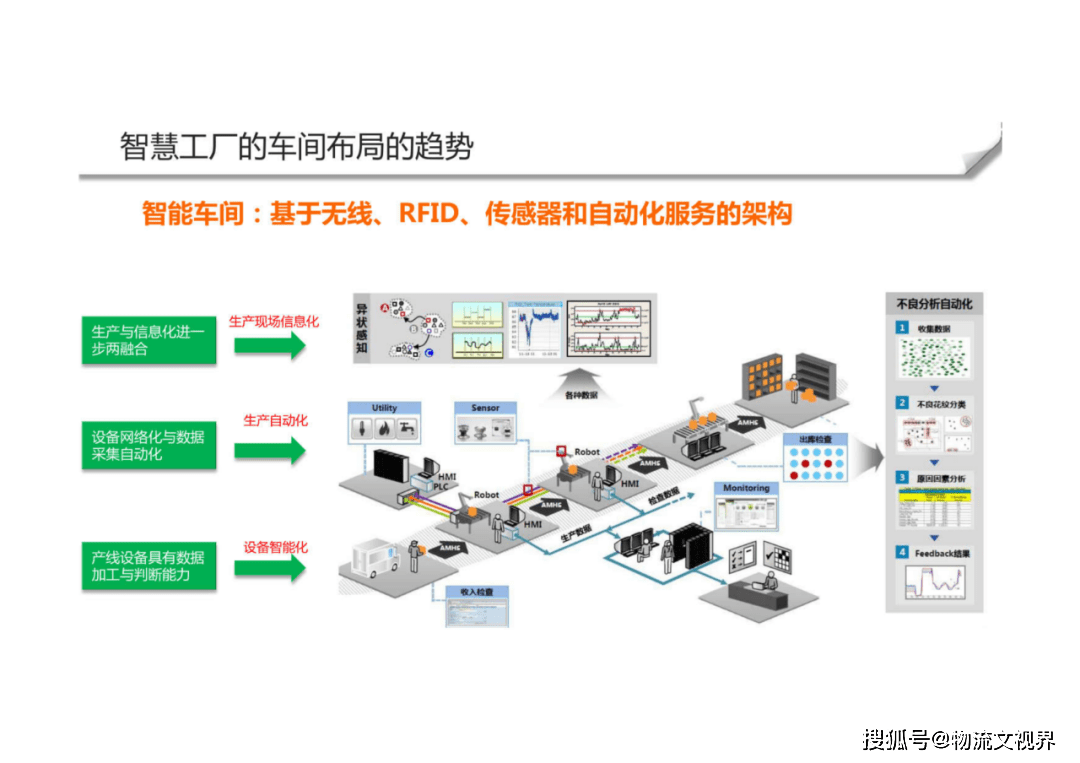

- 人工智能与大数据: AI训练涉及海量参数的同步(如All-Reduce操作),高带宽、低延迟的网络是缩短训练时间的关键。浪潮的加速技术确保了计算节点间梯度交换的高效性,加速模型迭代。

- 高性能计算(HPC): 在气象预测、流体力学模拟等科学计算中,成千上万的处理器需要频繁交换中间结果。RDMA技术构建的低延迟网络是保证整体计算效率的基石。

- 金融科技与实时交易: 微秒级的延迟差异可能意味着巨大的损益。内核旁路和协议卸载技术为高频交易系统提供了确定性的超低延迟网络响应。

- 分布式存储: 在软件定义存储(SDS)架构中,存储节点间需要高速同步数据。RDMA技术极大地提升了存储池的吞吐量和访问速度,降低了IO延迟。

三、未来展望:与先进网络技术的融合

浪潮服务器网络I/O加速技术将持续演进,与更先进的网络架构深度融合:

- 拥抱400G/800G乃至更高带宽: 随着网卡带宽的不断提升,加速技术需要更高效地管理数据流,避免成为新的瓶颈。

- 与CXL(Compute Express Link)互联技术结合: CXL有望实现内存池化与共享,网络I/O加速技术将与内存加速技术协同,打造更统一、高效的数据中心内部互联。

- 智能化与可编程性: 通过可编程芯片(如FPGA)和软件定义硬件,使网络加速功能能够根据特定应用(如5G核心网UPF)动态定制和加载,实现更极致的性能与灵活性。

- 全面支持IPv6与新一代传输协议: 为未来网络环境做好协议层面的准备与优化。

###

浪潮服务器网络I/O加速技术,通过深度的软硬件协同创新,正有效破解数据中心内部的数据流动瓶颈。它不仅是一套提升带宽和降低延迟的工具,更是构建敏捷、高效、智能的下一代算力基础设施的核心组成部分。随着数字化转型的深入,这项技术将成为各行业提升其网络技术服务能力、挖掘数据价值不可或缺的强力引擎,驱动着从计算到智算的全面升级。